论文阅读四十三:测试时高效学习:LLMs的主动微调

摘要

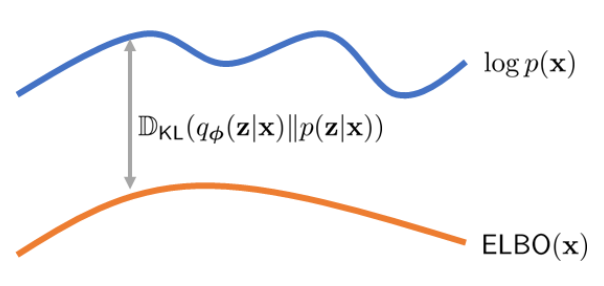

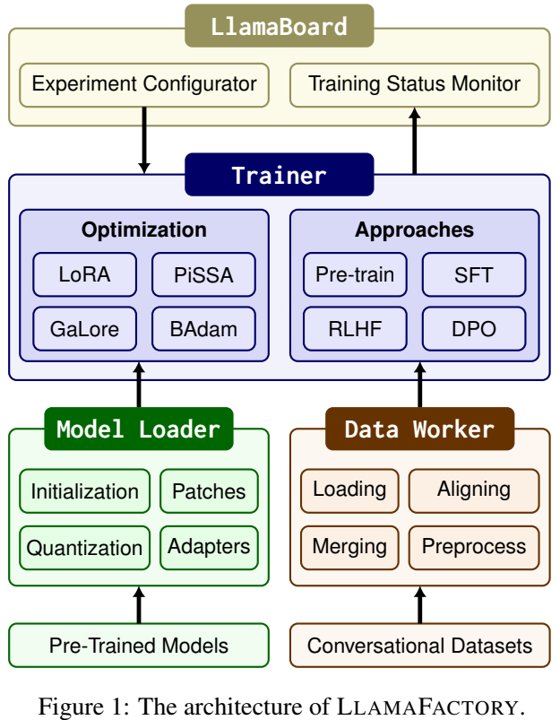

微调语言模型的近期努力常常依赖于自动数据选择,通常使用来自大型数据集的最近邻检索。然而,我们理论性说明,这种方法倾向于选择冗余数据,限制了它的效率,甚至有损性能。为此,我们引入SIFI,一种数据选择算法,旨在减少给定提示模型响应的不确定性,它统一了来自检索和主动学习的思想。鉴于最近邻检索常常在存在信息重复时失败,SIFT考虑到信息重复,并优化选择样本的整体信息增益。我们的评估重点是在测试时对Pile数据集上的提示特定语言建模进行微调,并表明SIFT在计算开销最小的情况下始终优于最近邻检索。此外,我们证明了我们的不确定性估计可以预测测试时间微调的性能增益,并利用这一点开发了一种自适应算法,该算法将测试时间计算与实现的性能增益成比例。我们提供了activeft(主动微调)库,可以作为最近邻检索的直接替代品。 论文地址

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Model The World!