论文阅读五十五:Transformer2:自适应LLMs

摘要

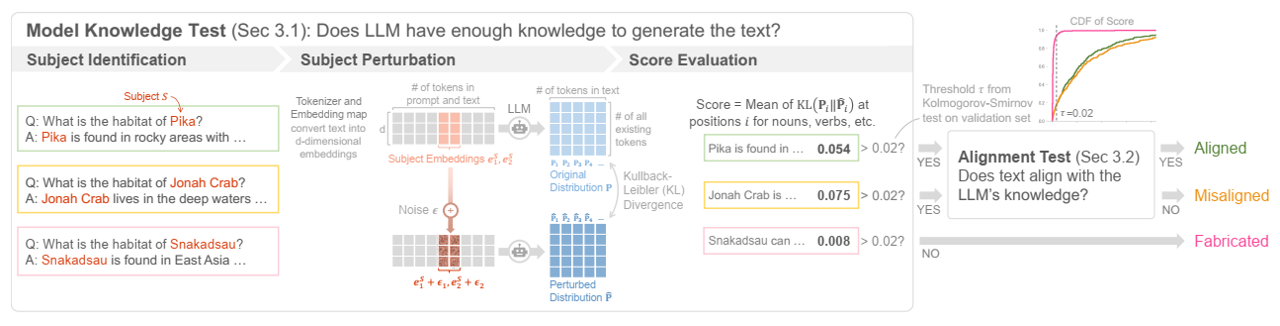

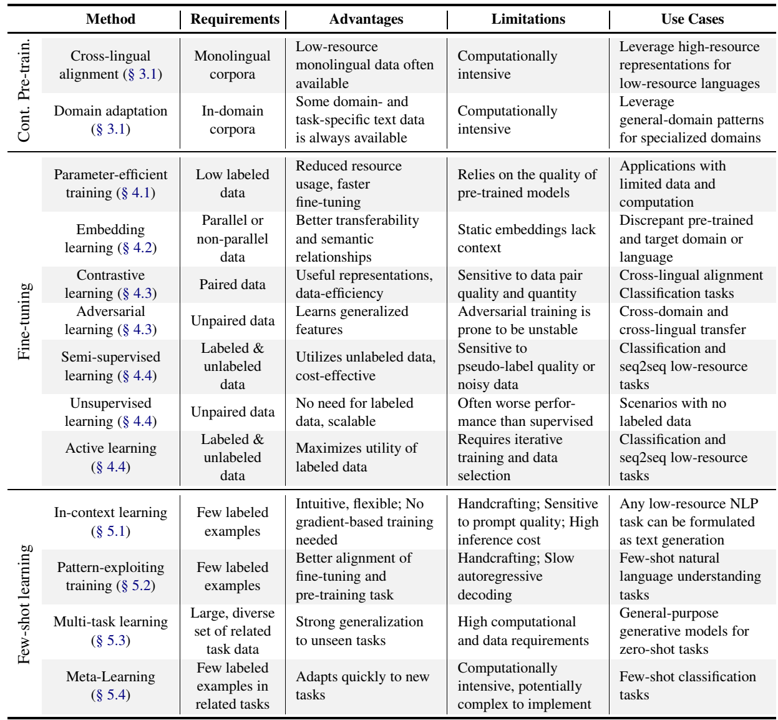

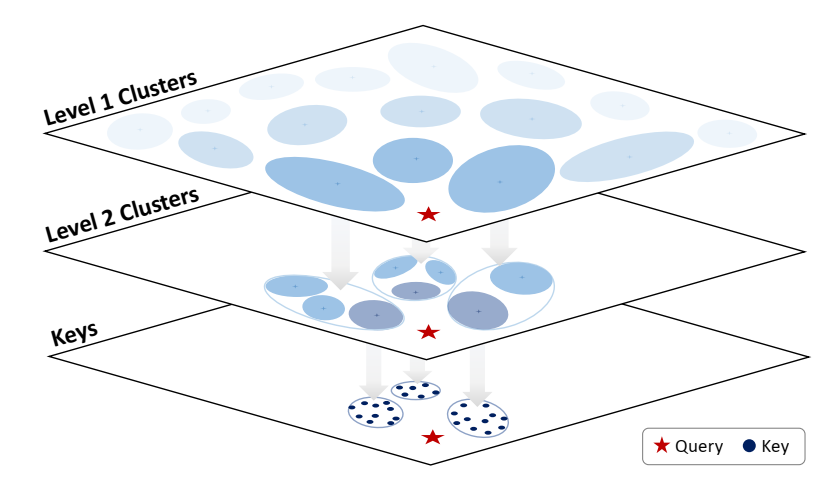

自适应大型语言模型(LLM)旨在解决传统微调方法带来的挑战,这些方法通常计算密集,处理各种任务的能力是静态的。我们介绍了Transformer2,这是一种新颖的自适应框架,通过选择性地仅调整LLM权重矩阵的奇异分量,实时调整LLM以适应看不见的任务。在推理过程中,Transformer2采用了两步机制:首先,调度系统识别任务属性,然后使用强化学习训练的特定于任务的“专家”向量被动态混合,以获得传入提示的目标行为。我们的方法优于LoRA等无处不在的方法,参数更少,效率更高。Transformer2展示了不同LLM架构和模式的多功能性,包括视觉语言任务。Transformer2代表了一次重大的飞跃,它提供了一种可扩展、高效的解决方案,用于增强LLM的适应性和特定任务的性能,为真正动态、自组织的人工智能系统铺平了道路。代码在 https://github.com/SakanaAI/self-adaptive-llms

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Model The World!