论文阅读五十四:Titans:在测试时学习记忆

摘要

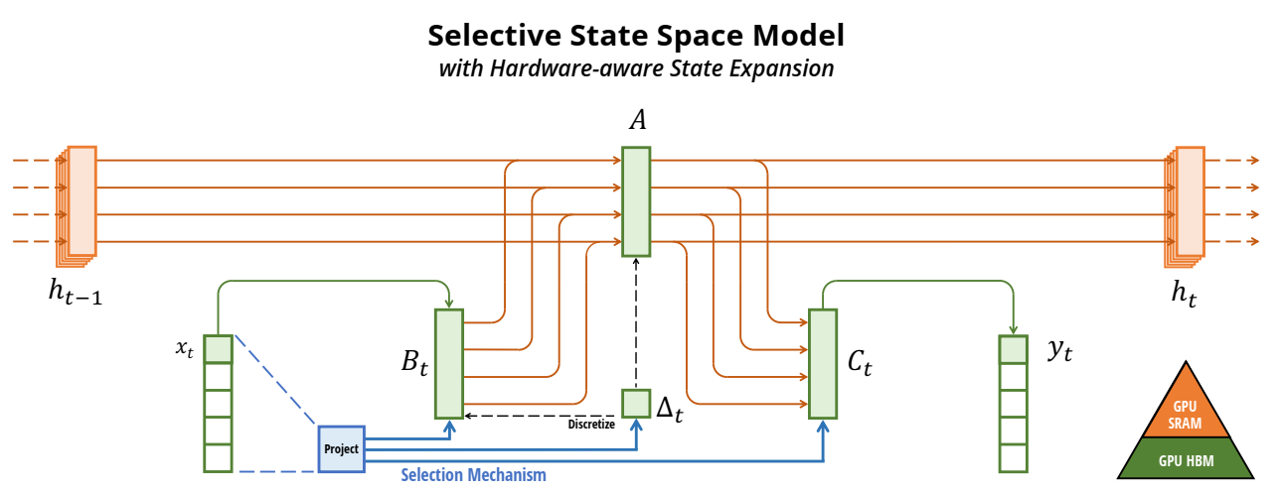

十多年来,人们对如何有效利用循环模型和注意力进行了广泛的研究。虽然循环模型旨在将数据压缩到固定大小的内存中(称为隐藏状态),但注意力允许关注整个上下文窗口,捕获所有标记的直接依赖关系。然而,这种更精确的依赖关系建模伴随着二次成本,将模型限制在固定长度的上下文中。我们提出了一种新的神经长期记忆模块,可以学习记忆历史背景,并在利用很久以前的信息的同时帮助注意力关注当前的上下文。我们证明,这种神经记忆具有快速并行训练的优点,同时保持了快速推理。从记忆的角度来看,我们认为注意力由于其有限的上下文但精确的依赖性建模而表现为短期记忆,而神经记忆由于其记忆数据的能力而表现为长期、更持久的记忆。基于这两个模块,我们介绍了一个新的架构系列,称为Titans,并提出了三种变体,以解决如何将内存有效地整合到这个架构中。我们在语言建模、常识推理、基因组学和时间序列任务方面的实验结果表明,Titans比Transformer和最近的现代线性递归模型更有效。与基线相比,它们还可以有效地扩展到大于2M的上下文窗口大小,在大海捞针任务中具有更高的精度。论文地址

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Model The World!