论文阅读四:CMs:简化,稳定和缩放连续时间一致性模型

摘要 一致性模型(CMs)是一类强大的基于扩散的生成模型,针对快速采样进行了优化。大多数现有的CMs都是使用离散化时间步长训练的,这会引入额外的超参数,并且容易出现离散化误差。虽然连续时间公式可以缓解这些问题,但它们的成功受到训练不稳定性的限制。为了解决这个问题,我们提出了一个简化的理论框架,该框架将之前扩散模型和CMs的参数化统一起来,确定了不稳定的根本原因。基于这一分析,我们介绍了扩散过程参数化、网络架构和训练目标方面的关键改进。这些变化使我们能够以前所未有的规模训练连续时间CMs,在ImageNet 512×512上达到1.5B参数。我们提出的训练算法仅使用两个采样步骤,在CIFAR-10上实现了2.06的FID得分,在ImageNet 64×64上实现了1.48的FID分数,在ImageNet...

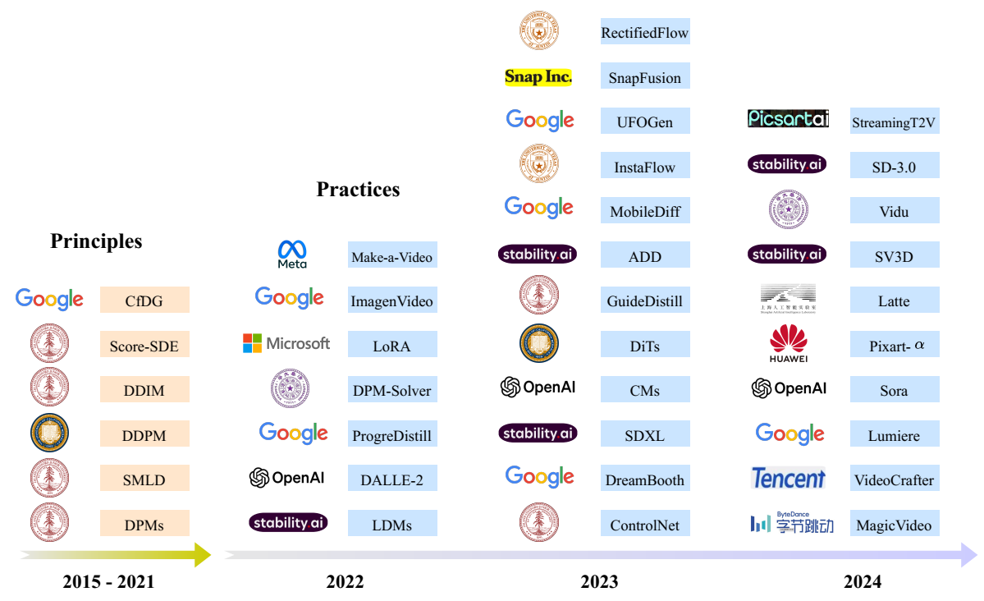

扩散模型中的量化、加速和采样方法

1. 量化方法 核心思想: 量化方法旨在通过将模型参数和激活值从高精度转换为低精度来减小模型大小和计算量,从而提高模型效率。例如,将 FP32 精度的参数转换为 FP16 或 INT8 精度。 工作流程: 训练: 模型量化可以在训练过程中或训练后进行。 推理: 推理阶段使用量化后的模型,通常需要特定的硬件或软件支持。 对象: 模型参数和激活值。 优缺点: 优点: 减少内存占用,允许在资源受限的设备上部署模型。 降低计算量,提高推理速度。 降低功耗,延长电池寿命(尤其适用于移动设备)。 缺点: 可能导致精度损失,需要权衡模型大小/速度和性能。 需要仔细选择量化方法和精度,以最小化精度损失。 应用: 量化方法广泛应用于各种深度学习模型中,包括扩散模型,以提高效率并使其更易于部署。 关于扩散模型量化的额外信息: 来源中没有明确提及特定于扩散模型的量化方法。有关量化方法的更多信息来自外部知识,您可能需要独立核实。 2. 加速方法 核心思想: 加速方法旨在通过减少采样过程中的迭代次数或计算量来提高扩散模型的生成速度。 工作流程: 训练:...

去噪扩散概率模型、基于分数的生成模型和随机微分方程之间的关系和区别

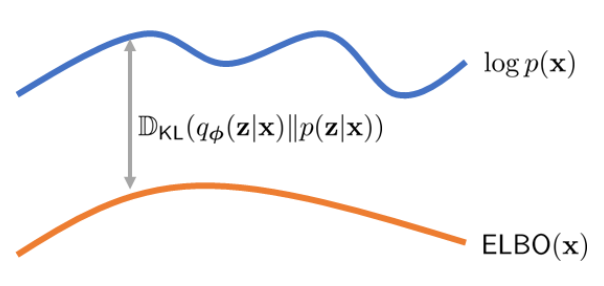

概述 去噪扩散概率模型(DDPM)、基于分数的生成模型(SGM)和随机微分方程(SDE)都是强大的生成模型工具,它们之间有着密切的联系。DDPM 和 SGM 可以被视为 SDE 框架下的特定实例,而 SDE 为理解和改进扩散模型提供了一个统一的数学框架。 核心思想 DDPM:DDPM 的核心思想是通过逆转一个逐渐加噪的过程来从分布中采样。模型通过学习从噪声样本中预测去噪样本,逐步从信号中去除噪声来生成样本。其训练目标可以表示为重新加权的变分下界。 SGM:SGM 使用数据分布的分数(即对数概率密度的梯度)来学习生成模型。这些模型通过使用分数来引导采样过程,从简单的噪声分布开始生成样本。 SDE:SDE 用于对包含随机成分的系统进行建模。在生成模型的背景下,SDE 用于描述正向加噪过程和逆向去噪过程。DDPM 和 SGM 中的正向过程都是该 SDE 的离散化。 主要数学公式 DDPM:DDPM...

流匹配与扩散模型的联系和区别

流匹配与扩散模型的联系和区别 核心思想 扩散模型: 扩散模型的核心思想是通过逆转一个逐渐加噪的过程来从分布中采样。 模型通过逐步从信号中去除噪声来生成样本,其训练目标可以表示为重新加权的变分下界。 流匹配: 流匹配是一种基于连续归一化流 (CNF) 的生成模型的新范式。 其核心思想是使用固定条件概率路径的向量场回归来训练 CNF。 流匹配允许使用各种概率路径来监督 CNF 训练,包括扩散路径和最优传输 (OT) 路径。 模型架构 扩散模型: 扩散模型通常使用 UNet 架构,该架构由一系列残差层和下采样卷积组成,然后是一系列具有上采样卷积的残差层,跳过连接连接具有相同空间大小的层。 流匹配: 流匹配使用 CNF 作为其模型架构。 CNF 是由一系列可逆变换组成的生成模型,这些变换可以将简单分布(例如,标准正态分布)转换为复杂数据分布。 流匹配中的 CNF 可以使用各种架构,例如 UNet 或基于 Transformer 的架构。 主要数学公式 扩散模型:...

从GANs到扩散模型到自回归模型

扩散模型胜过 GAN 的原因 更易于缩放和训练:与 GAN 相比,扩散模型通常更容易缩放和训练。这是因为 GAN 存在臭名昭著的训练不稳定性,并且可能难以捕获数据分布的全部多样性。 更好的分布覆盖率:扩散模型能够更好地覆盖数据分布,从而产生更多样化的样本。GAN 通常会牺牲多样性来换取保真度,从而导致样本质量高但无法涵盖整个分布。 静态训练目标:扩散模型具有静态训练目标,这使得它们更容易优化。另一方面,GAN 具有对抗性训练目标,这可能导致训练动态不稳定。 自回归模型胜过扩散模型的原因 与大型语言模型 (LLM) 的范式一致:自回归模型与 LLM 使用相同的“下一个标记预测”范式。这使得使用 LLM 的进步来改进自回归图像生成模型成为可能。 潜在的统一语言和视觉模型:自回归方法有可能在语言和视觉之间建立统一的模型。扩散模型具有与自回归语言模型不同的范式,这给建立语言和视觉的统一模型带来了巨大的挑战。 利用 LLM 框架的优势:自回归模型可以利用 LLM 社区开发的技术来优化训练方法和推理速度。 三种模型的核心思想、模型架构和主要进展 生成对抗网络...

What's 'static mean in Rust

In Rust, 'static is a special lifetime that signifies that the data lives for the entire duration of the program. Here are some key points about 'static: Key Characteristics Longest Lifetime: The 'static lifetime is the longest possible lifetime. Any data with a 'static lifetime can be accessed anywhere in the program without worrying about it being dropped or going out of scope. String Literals: String literals have a 'static lifetime because they are hardcoded into the program and...

What's derive mean in Rust

In Rust, the term “derive” typically refers to a procedural macro that automatically implements certain traits for your structs or enums. This feature helps reduce boilerplate code by generating implementations based on the structure of your types. Common Usage of derive When you use the #[derive(...)] attribute above a struct or enum, you’re telling the Rust compiler to automatically generate implementations of specified traits. Some common traits that can be derived include: Debug:...